Aktualisiert März 2026

Beste KI-Dubbing-Tools 2026: Wir haben 5 Plattformen mit demselben Material getestet

Der Qualitätsunterschied zwischen den Plattformen ist enorm. Einige Tools, die auf Affiliate-Blogs auf Platz 1 stehen, lieferten sichtbar fehlerhafte Ergebnisse. Das haben wir herausgefunden, nachdem wir alle mit demselben Material getestet haben.

Die Marke hatte bereits einen sechsstelligen Betrag in ein Produktlaunch-Video investiert. Der CEO war vor der Kamera, die Beleuchtung perfekt, das Skript hatte vier Freigaberunden durchlaufen. Dann fragte jemand: Können wir das bis nächstes Quartal auf Spanisch, Französisch und Englisch haben? Diese Frage hat uns dazu gebracht, drei Monate lang jede wichtige KI-Dubbing-Plattform auf dem Markt zu testen — denn die falsche Wahl verschwendet nicht nur Budget. Sie produziert Ergebnisse, die deine Marke schlechter aussehen lassen, als hätte man gar nicht übersetzt.

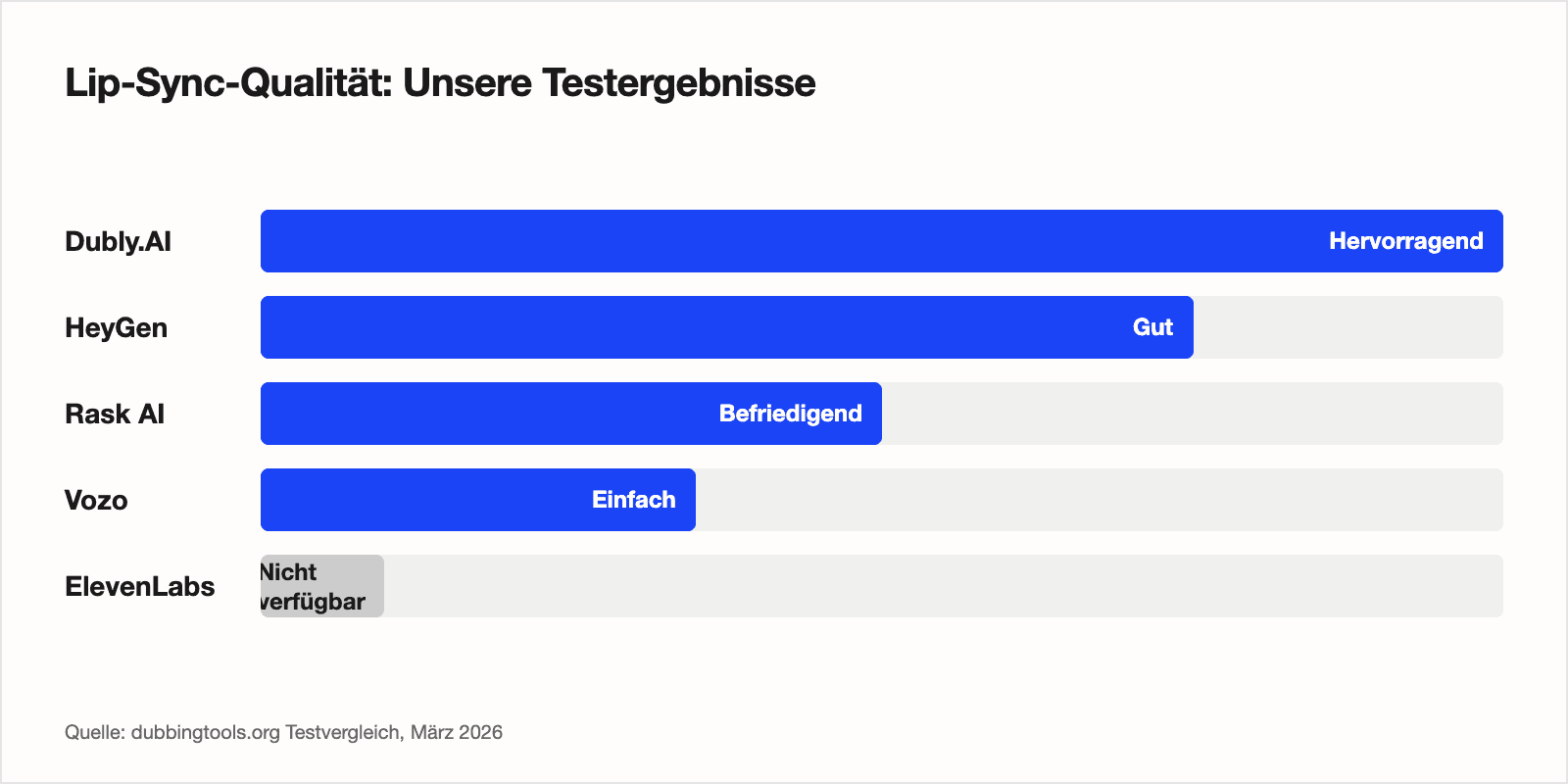

Auf einen Blick: Alle 5 Tools im Vergleich

| Tool | Ideal für | Lip Sync | Sprachen | Ab | Datenschutz |

|---|---|---|---|---|---|

| Dubly.AI | Enterprise-Dubbing | Hervorragend | 32+ | €79/month | EU 🇪🇺 |

| HeyGen | KI-Avatar-Videos | Gut | 175+ | $29/month | EU 🇪🇺 |

| Rask AI | Audio-Dubbing (Masse) | Befriedigend | 135+ | $60/month | US 🇺🇸 |

| ElevenLabs | Voice Cloning | k. A. | 29+ | $5/month | US 🇺🇸 |

| Vozo | Solo-Creator | Befriedigend | 74 Zielsprachen (111+ Quellsprachen) | $29/month | US 🇺🇸 |

Das eine technische Detail, das Spitzenreiter vom Rest trennt

Die meisten KI-Video-Tools begannen als Avatar-Plattformen. Sie lernten, Lippenbewegungen auf synthetischen Gesichtern zu synchronisieren — eine grundlegend andere technische Herausforderung als die Synchronisation bei einer echten Person vor der Kamera. Als diese Avatar-first-Plattformen Videoübersetzung hinzufügten, haben sie eine Technologie, die für kontrollierte digitale Umgebungen entwickelt wurde, auf reales Videomaterial mit wechselnder Beleuchtung, Kopfbewegungen und Verdeckungen übertragen.

Dieser Unterschied ist wichtiger als die Anzahl der Sprachen, die Preisstufe oder die Feature-Liste. Als wir denselben 4-minütigen Interview-Clip durch alle fünf Plattformen laufen ließen, war der Unterschied sofort offensichtlich. Manche produzierten Ergebnisse, bei denen man wirklich vergaß, dass man ein synchronisiertes Video anschaute. Andere ließen den Sprecher aussehen wie in einem schlecht synchronisierten Auslandsfilm aus den 90ern.

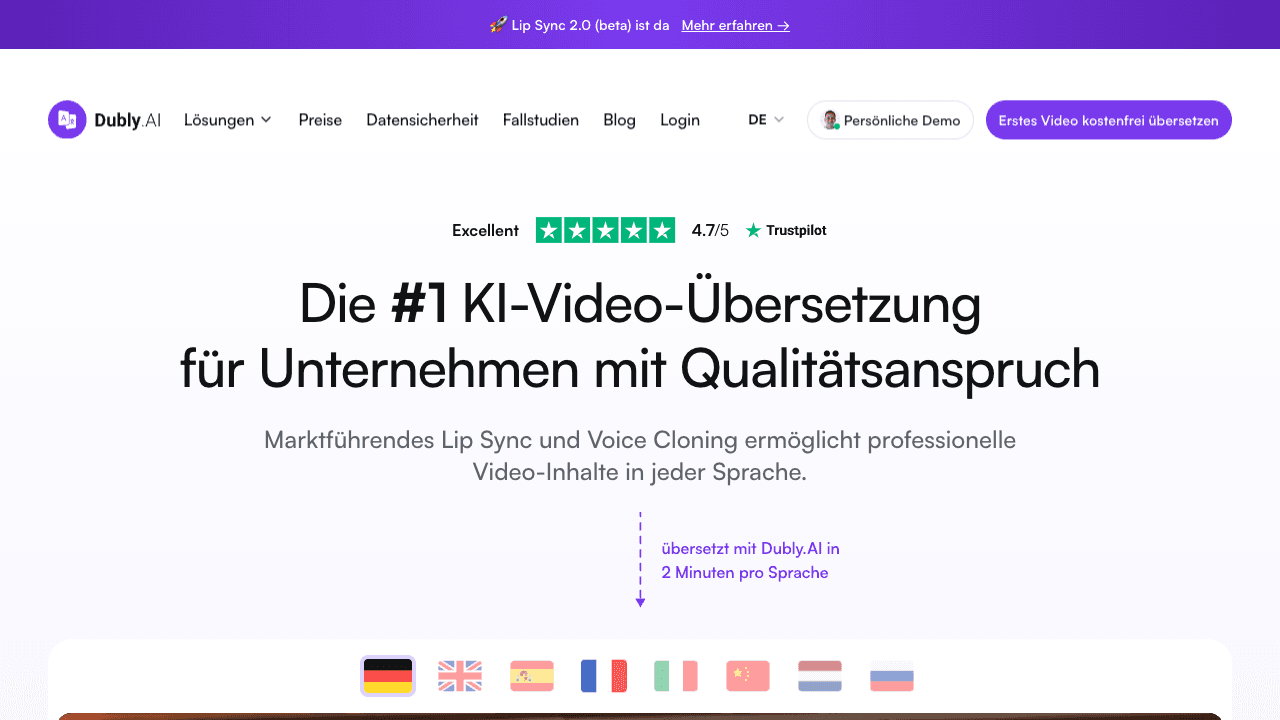

Ideal für Lip-Sync-Qualität & Datenschutz

Dubly.AI

Dubly.AI ist das Ergebnis, wenn ein Unternehmen sich ausschließlich auf eine Sache konzentriert und sie besser macht als alle anderen. Gegründet in Deutschland mit einem einzigen Fokus — echtes Videomaterial in andere Sprachen zu übersetzen mit perfekt synchronisierten Lippenbewegungen — bietet die Plattform keine Avatar-Funktion, kein Text-to-Video-Tool, keinen Social-Media-Planer. Nur Dubbing, auf einem Niveau, das der breitere Markt noch nicht erreicht hat.

In unserem Test lieferte Dublys Lip Sync 2.0 durchgängig die natürlichsten Ergebnisse bei jedem Videotyp, den wir durchgetestet haben. Der Abstand zum nächsten Wettbewerber war nicht subtil — es war der Unterschied zwischen einem Ergebnis, das dein Publikum anschaut, ohne etwas zu bemerken, und einem Ergebnis, das sofort signalisiert: „Das wurde von Software synchronisiert.“

Vier spezifische Fähigkeiten treiben diesen Vorsprung. Occlusion Handling bewahrt die strukturelle Integrität, wenn Hände, Mikrofone oder Brillen das Gesicht des Sprechers verdecken — bei Material, wo die Hand des Sprechers mitten im Satz den Mund verdeckte, hat Dubly es nahtlos verarbeitet, während HeyGen sichtbare Störungen um den Kiefer zeigte. Dynamisches Bewegungstracking hält die Synchronisation bei Kopfdrehungen und schnellen Bewegungen aufrecht. Multi-Sprecher-Erkennung isoliert einzelne Sprecher automatisch. Und die Verarbeitungsgeschwindigkeit ist 90 % schneller als die Vorgängerversion.

Die Datenschutz-Story ist entscheidend, wenn du im europäischen Markt tätig bist oder an europäische Kunden verkaufst. Als deutsches Unternehmen ist Dubly DSGVO-konform mit Servern, die physisch in Deutschland stehen. Kundendaten werden niemals für KI-Training verwendet. Ein vollständiger Auftragsverarbeitungsvertrag (AVV) ist verfügbar. Für Marken, die interne Schulungsvideos, Kundenstimmen oder andere personenbezogene Daten verarbeiten, ist das ein entscheidender Differenzierungsfaktor. Eine Agentur, mit der wir gesprochen haben, ist genau deshalb gewechselt — sie konnten Kundenmaterial nicht auf US-Server schicken.

Der ehrliche Kompromiss: 38 Sprachen gegenüber 100–175 bei der Konkurrenz. Kein kostenloser Tarif. Die Benutzeroberfläche ist funktional, aber nicht so poliert wie die von HeyGen. Und mit 79 €/Monat für den Einsteigertarif ist es nicht die günstigste Option. Wenn du Suaheli oder Thai brauchst, bist du hier falsch — aber für die großen europäischen und asiatischen Sprachen rechtfertigt die Qualität den Kompromiss.

Stärken

- ✓ Hervorragender Lip Sync — mit Abstand die besten Ergebnisse in unserem Test

- ✓ Volle DSGVO-Konformität, deutsche Server

- ✓ Benutzerdefiniertes Vokabular und Markenstimme

- ✓ Unbegrenzte Überarbeitungen in allen Tarifen

Schwächen

- ✗ 38 Sprachen (vs. 175 bei HeyGen)

- ✗ Kein kostenloser Tarif verfügbar

- ✗ Benutzeroberfläche weniger poliert als bei der Konkurrenz

- ✗ Geringere Markenbekanntheit

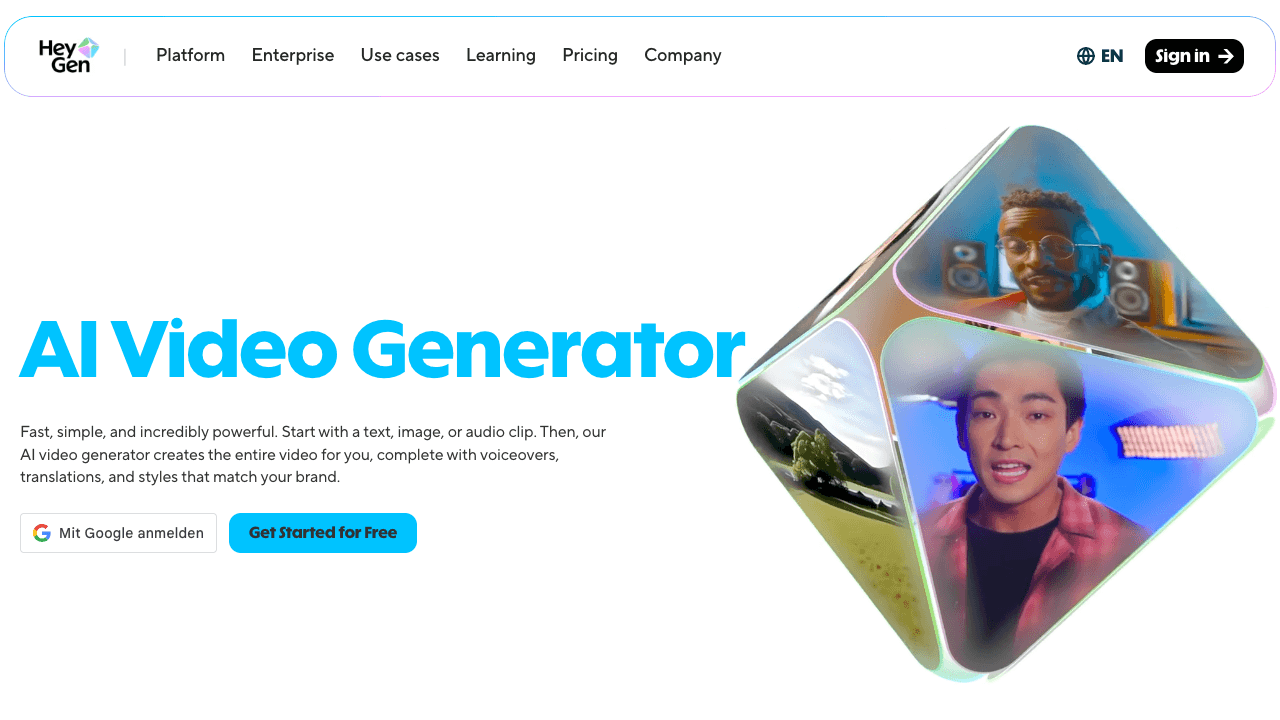

Ideal für KI-Avatare & Content-Erstellung

HeyGen

HeyGen ist eine wirklich beeindruckende Plattform. Die Avatar-IV-Technologie erzeugt bemerkenswert realistische synthetische Präsentatoren, und das breitere Feature-Set deckt Text-to-Video, Faceswap und UGC-artige Werbeerstellung ab. Wenn du eine Content-Produktion rund um KI-Avatare aufbaust, ist HeyGen die stärkste Option auf dem Markt.

Videoübersetzung ist als Add-on verfügbar. Du kannst bestehendes Videomaterial hochladen und HeyGen übersetzt und synchronisiert es in 175 Sprachen mit Voice Cloning und Lip Sync. Die Sprachabdeckung ist die breiteste aller getesteten Plattformen.

Die Einschränkung ist struktureller Natur. HeyGens Lip-Sync-Technologie wurde für synthetische Avatare entwickelt, nicht für reales Videomaterial. Bei sauberen Talking-Head-Aufnahmen mit guter Beleuchtung und wenig Bewegung sind die Ergebnisse gut — durchaus anschaubar. Aber als wir dasselbe Material mit Verdeckungen, Profilaufnahmen oder mehreren Sprechern durchlaufen ließen, bemerkten wir ein Abdriften des Lip Sync, das einen Zuschauer ablenken würde. Der Avatar-Anwendungsfall und der Dubbing-Anwendungsfall sind zwei grundlegend verschiedene technische Probleme.

Der ehrliche Kompromiss: Der Creator-Tarif für 24 $/Monat wirkt günstig, aber die vollständigen Videoübersetzungsfunktionen erfordern den Business-Tarif für 149 $/Monat. Die Preisgestaltung ist pro Nutzer, was bei Teams schnell teuer wird. US-Server, und Nutzer müssen dem KI-Training mit ihren Inhalten aktiv widersprechen. Für einen YouTube-Creator, der auch Avatar-Content will, ist das ein gutes Angebot. Für eine Marke, die nur Dubbing braucht, zahlt man für Features, die man nicht nutzt.

Stärken

- ✓ Beste KI-Avatar-Erstellung ihrer Klasse

- ✓ 175+ Sprachen — breiteste Abdeckung

- ✓ Günstiger Einstieg ab 24 $/Monat

- ✓ All-in-One-Plattform für Content-Erstellung

Schwächen

- ✗ Lip-Sync-Artefakte bei echtem Videomaterial mit Bewegung

- ✗ Volle Übersetzung erfordert 149 $/Monat-Tarif

- ✗ Pro-Nutzer-Preise summieren sich

- ✗ Opt-out-Modell für KI-Training

Ideal für Audio-Dubbing im großen Stil

Rask AI

Rask AI hat eine ausgereifte, gut gestaltete Plattform für Video-Lokalisierung aufgebaut, mit besonderer Stärke bei hochvolumigen Audio-Dubbing-Workflows. Die Plattform übernimmt Transkription, Übersetzung, Voice Cloning und Dubbing in 130 Sprachen in einer einheitlichen Oberfläche. Die SOC-2-Type-II-Zertifizierung ist für Enterprise-Käufer relevant, die dokumentierte Sicherheits-Compliance benötigen.

Wo Rask wirklich Mehrwert liefert, ist bei Inhalten, bei denen der Sprecher nicht prominent im Bild ist. Podcasts, Voiceover-Erzählungen, Schulungsinhalte, bei denen Folien das Bild dominieren — das sind Szenarien, in denen die Lip-Sync-Qualität irrelevant ist und Rasks Geschwindigkeit und Workflow-Effizienz den Ausschlag geben. Wir haben 12 Podcast-Episoden durch die Pipeline geschickt und die Ergebnisse waren schnell, sauber und das Voice Cloning solide.

Wo Rask Schwächen zeigt, ist genau dort, wo Lip Sync wichtig ist. Als wir dasselbe Talking-Head-Material durch Rask laufen ließen, das wir auf jeder Plattform getestet haben, war die Abweichung zwischen Mundbewegungen und Audio sofort sichtbar. Das ist eine Lücke, die jedem Zuschauer auffällt, nicht nur jemandem, der danach sucht. Und Lip Sync ist nur im Creator-Pro-Tarif für 150 $/Monat verfügbar.

Der ehrliche Kompromiss: Für 60 $/Monat im Creator-Basistarif (nur Audio-Dubbing) bietet Rask ein starkes Preis-Leistungs-Verhältnis für Audio-first-Inhalte. Aber wenn du Lip Sync auf echtem Videomaterial brauchst, liefert der 150 $/Monat Creator-Pro-Tarif Ergebnisse, die deutlich unter dem Kategorieführer liegen. Serverstandort außerhalb der EU. Für eine Schulungsabteilung, die E-Learning-Kurse synchronisiert, bei denen Folien den Bildschirm füllen, ist Rask hervorragend. Für kundengerichtetes Video lieber woanders schauen.

Stärken

- ✓ 130+ Sprachen, ausgereifte Plattform

- ✓ SOC 2 Type II zertifiziert

- ✓ Hervorragend für Podcasts und Voiceover

- ✓ Schnelle Verarbeitung, sauberer Workflow

Schwächen

- ✗ Lip Sync sichtbar asynchron bei echtem Videomaterial

- ✗ Lip Sync erfordert 150 $/Monat-Tarif

- ✗ US-Server, keine DSGVO-Konformität

- ✗ Eingeschränkte Multi-Sprecher-Verarbeitung

Voice Cloning & Dubbing Studio

ElevenLabs

ElevenLabs startete als die beste Voice-Cloning- und Text-to-Speech-Plattform auf dem Markt — und das ist sie immer noch. Aber mit dem Launch des Dubbing Studios ist sie auch zu einem ernstzunehmenden Dubbing-Tool geworden. Du kannst ein Video hochladen, und ElevenLabs transkribiert, übersetzt und synchronisiert es in 29 Sprachen — der Export erfolgt als MP4 bis 4K.

Die Voice-Cloning-Qualität ist wirklich die beste ihrer Klasse. Man gibt ein paar Minuten Quell-Audio ein und die synthetische Ausgabe ist oft nicht vom Originalsprecher zu unterscheiden. Die API ist gut gestaltet, die Dokumentation ist stark, und mit 5 $/Monat für den Starter-Tarif ist der Einstiegspreis der niedrigste aller Plattformen auf dieser Liste.

Die entscheidende Einschränkung: ElevenLabs ersetzt die Tonspur, verändert aber nicht das Video. Es gibt kein Lip Sync — der Mund des Sprechers zeigt weiterhin die Bewegungen der Originalsprache. Für Podcasts, Voiceovers oder Inhalte, bei denen der Sprecher nicht prominent im Bild ist, spielt das keine Rolle. Bei Talking-Head-Videos ist der Unterschied sichtbar. Manche Teams nutzen ElevenLabs für das Voice Cloning und leiten das Audio dann in ein dediziertes Lip-Sync-Tool wie Sync Labs — aber das ist ein Zwei-Tool-Workflow.

Stärken

- ✓ Beste verfügbare Voice-Cloning-Qualität

- ✓ Kostenloser Tarif + 5 $/Monat Starter

- ✓ Dubbing Studio gibt Video aus (MP4 bis 4K)

- ✓ Hervorragende Entwickler-API

Schwächen

- ✗ Kein Lip Sync — Mundbewegungen bleiben in Originalsprache

- ✗ 29 Dubbing-Sprachen (vs. 130+ bei Synthesia)

- ✗ Audio-first-Plattform, Video-Dubbing ist Sekundärfeature

- ✗ US-Server, Opt-out-KI-Training

Ideal für Creator mit kleinem Budget

Vozo

Vozo ist der zugänglichste Einstieg in KI-Video-Dubbing. Für 29 $/Monat im Creator-Tarif (mit kostenlosem Tarif zum Testen) kostet es einen Bruchteil der professionellen Plattformen und deckt dennoch die Grundlagen ab: Übersetzung, Dubbing, Lip Sync und On-Screen-Textübersetzung in 74 Zielsprachen.

Die Content-Repurposing-Funktion ist eine nette Ergänzung — sie wandelt Langform-Videos in Kurzclips für die Social-Media-Distribution um. Für einen Solo-Creator, der YouTube-Videos synchronisiert, oder eine kleine Marke, die Lokalisierung zum ersten Mal testet, bietet Vozo genug Funktionalität, um das Experimentieren risikoarm zu gestalten. Wir haben beobachtet, wie ein Creator damit ein 10-minütiges Produktreview auf Spanisch synchronisiert hat — die Bearbeitungszeit war beeindruckend schnell. Der Lip Sync war für den Preis überraschend genau.

Die Kompromisse sind real. Die Lip-Sync-Genauigkeit lässt bei schneller Sprache oder überlappenden Dialogen spürbar nach, und bei Material mit schnellen Bewegungen oder Verdeckungen sind die Ergebnisse weniger konsistent. Keine unbegrenzten Überarbeitungen, kein Marken-Glossar im Creator-Tarif, und kein API-Zugang außer im Enterprise-Tarif. Dies ist ein Einsteiger-Tool mit echtem Potenzial — aber wenn deine Produktionsstandards Broadcast-Qualität erfordern, wirst du es hinter dir lassen.

Stärken

- ✓ Kostenloser Tarif + günstiger Creator-Tarif ab 29 $/Monat

- ✓ 74 Zielsprachen (111+ Quellsprachen)

- ✓ Content-Repurposing-Funktion

- ✓ Überraschend guter Lip Sync für den Preis

Schwächen

- ✗ Lip Sync lässt bei schneller Sprache und überlappenden Dialogen nach

- ✗ Kein API-Zugang (außer Enterprise)

- ✗ Keine Überarbeitungen, kein Glossar im Creator-Tarif

- ✗ Eingeschränkte Datenschutz-Dokumentation

Wie du wählst: Eine Entscheidung nach Anwendungsfall

„Ich muss echtes Videomaterial synchronisieren und Lip-Sync-Qualität ist wichtig.“

→ Dubly.AI. Die besten Lip-Sync-Ergebnisse in unserem Test, mit deutlichem Abstand. Wenn deine Sprecher vor der Kamera stehen, fang hier an.

„Ich möchte KI-Avatare und Übersetzung ist ein Zusatzbedarf.“

→ HeyGen. Beste Avatar-Technologie auf dem Markt. Übersetzung ist ein solides Add-on für Avatar-Inhalte, auch wenn Lip Sync bei echtem Material nicht die größte Stärke ist.

„Ich synchronisiere Podcasts und Voiceover, bei denen der Sprecher nicht im Bild ist.“

→ Rask AI. Starkes Audio-Dubbing im großen Maßstab. Lip-Sync-Einschränkungen spielen bei Audio-first-Inhalten keine Rolle, und der Workflow ist schnell.

„Ich brauche nur Voice Cloning — das Video mache ich separat.“

→ ElevenLabs. Beste Voice-Cloning-Qualität zum besten Preis. Nur Audio — du brauchst ein zweites Tool für Video.

„Ich bin Creator und teste Dubbing zum ersten Mal mit kleinem Budget.“

→ Vozo. Niedrigstes Risiko beim Einstieg. Gut genug zum Experimentieren, aber versteh, dass du es wahrscheinlich hinter dir lässt, wenn deine Ansprüche steigen.

Häufig gestellte Fragen

Was ist das beste KI-Dubbing-Tool 2026?

Es gibt kein einzelnes bestes Tool — es kommt auf den Anwendungsfall an. Für Lip-Sync-Qualität bei echtem Videomaterial lieferte Dubly.AI in unserem Test durchgängig die natürlichsten Ergebnisse. Für KI-Avatar-Erstellung mit Dubbing als Zusatzfunktion ist HeyGen am stärksten. Für Audio-Dubbing im großen Stil, bei dem Lip Sync irrelevant ist, bietet Rask AI den besten Workflow. Für budgetbewusste Creator ist Vozo der zugänglichste Einstieg.

Was kostet KI-Video-Dubbing?

KI-Dubbing-Plattformen reichen von 5 $/Monat (ElevenLabs für Audio-only TTS) bis 79 €/Monat (Dubly.AI für vollständiges Video-Dubbing mit Lip Sync). Professionelles Dubbing kostet traditionell ca. 80 € pro Videominute. KI-Plattformen haben dies auf ca. 5 € pro Minute reduziert — eine Kostensenkung von 94 %. Die tatsächlichen Kosten hängen von der Videolänge, ob Lip Sync enthalten ist, und dem gewählten Tarif ab.

Sieht KI-Lip-Sync wirklich natürlich aus?

Die Qualität variiert dramatisch zwischen den Plattformen. In unserem Test reichte die Bandbreite von hervorragend — wo synchronisierte Ergebnisse tatsächlich kaum von nativer Sprache zu unterscheiden waren — bis einfach, wo die Diskrepanz zwischen Mundbewegungen und Audio bei Nahaufnahmen deutlich sichtbar war. Der Unterschied ist am größten bei schwierigem Material mit Kopfbewegungen, Verdeckungen oder mehreren Sprechern. Wir empfehlen, eigenes Material in einer kostenlosen Testversion zu testen, bevor man sich festlegt.

Ist KI-Dubbing DSGVO-konform?

Die meisten KI-Dubbing-Tools sind standardmäßig nicht DSGVO-konform. Nur Dubly.AI speichert alle Daten auf EU-Servern (Deutschland), garantiert kein KI-Training mit Kundeninhalten und stellt einen vollständigen Auftragsverarbeitungsvertrag (AVV) bereit. US-basierte Plattformen wie HeyGen, Rask AI und Vozo verarbeiten Daten auf US-Servern nach US-Recht, was für europäische Nutzer andere Standardschutzmaßnahmen bedeutet.

Was ist der Unterschied zwischen KI-Dubbing und KI-Voice-Cloning?

KI-Dubbing ist der vollständige Prozess der Übersetzung von Videoinhalten in eine andere Sprache — einschließlich Transkription, Übersetzung, Sprachsynthese und optional Lip-Synchronisation. Voice Cloning ist eine Komponente dieses Prozesses: Es erstellt eine synthetische Kopie der Stimme eines Sprechers, damit die synchronisierte Version wie dieselbe Person klingt. ElevenLabs spezialisiert sich auf Voice Cloning, bietet aber kein Video-Dubbing an. Tools wie Dubly.AI und HeyGen kombinieren beides in einem End-to-End-Workflow.

Wie wir getestet haben

Wir haben identische Testvideos auf jede Plattform hochgeladen: eine Mischung aus Talking-Head-Interviews, Multi-Sprecher-Panels und Material mit Verdeckungen wie Händen, die das Gesicht kreuzen, Brillen und Mikrofonen. Wir haben die Lip-Sync-Qualität qualitativ über mehrere Betrachtungsrunden bewertet, die Preise durch Abschluss kostenpflichtiger Tarife verifiziert und Datenschutzangaben anhand veröffentlichter Dokumentation überprüft. Alle Tests wurden im März 2026 durchgeführt. Wir testen vierteljährlich erneut und aktualisieren diese Seite, wenn sich die Ergebnisse ändern.

Sources & Further Reading

- AI Video Translation Market Report — Market.us, October 2025

- AI Video Dubbing Market Outlook 2025-2032 — IntelMarketResearch, 2025